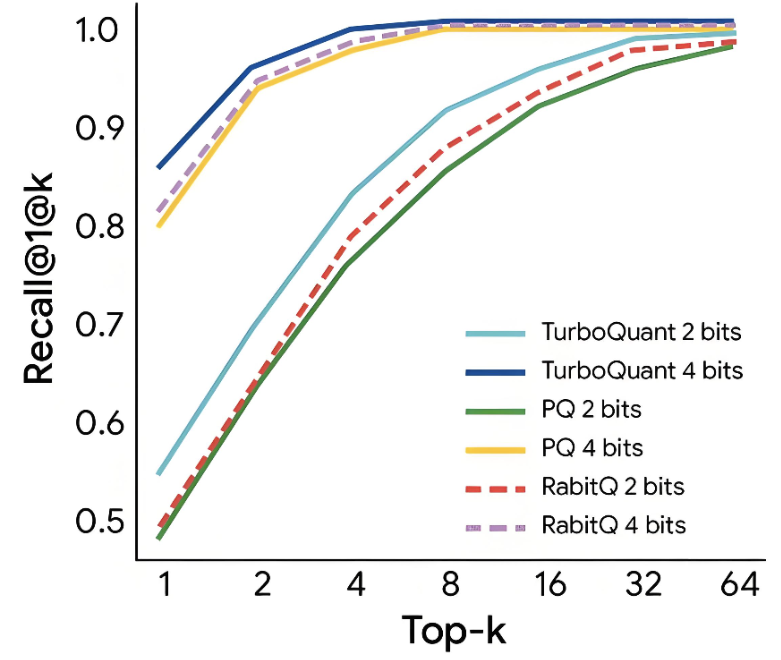

市场分析人士指出,存储芯片股周四的大幅下跌可能源于市场对谷歌新算法的误读。谷歌即将在国际学习表征会议(ICLR 2026)上展示的论文“TurboQuant”中,提出了一种超高效的AI内存压缩算法。该算法通过PolarQuant(极坐标量化)和QJL(量化JL变换)两项创新技术,实现了在“零损失”前提下将KV Cache压缩至3-bit精度,内存占用缩小至少6倍,并在H100 GPU加速器上实现了高达8倍的性能提升。有分析师强调,这一算法仅作用于推理阶段的键值缓存,并不影响模型权重所占用的高带宽内存(HBM),也与AI训练任务无关。

摩根士丹利在最新研报中重申了这一观点,指出市场可能存在误读。分析师强调,所谓“6倍压缩”并非存储总需求的减少,而是通过效率提升增加了单GPU的吞吐量。摩根士丹利分析师Shawn Kim认为,谷歌这项研究对行业的影响应更偏向积极,因为它解决了一个关键瓶颈,提高了推理阶段的效率,从而降低了每次查询的服务成本,使人工智能部署更具盈利性。

Lynx Equity Strategies分析师KC Rajkumar也指出,部分媒体报道存在夸大成分。他表示,当前推理模型早已广泛采用4-bit量化数据,谷歌所谓的“8倍性能提升”是建立在与老旧32位模型对比的基础之上。Rajkumar认为,由于供应极度紧张,这几乎不会降低未来3-5年对内存和闪存的需求。

富国银行分析师Andrew Rocha则从另一个角度解释了压缩算法对硬件采购的影响。他指出,压缩算法的存在从未从根本上改变硬件采购的整体规模,反而通过降低单次查询的服务成本,使模型能够迁移至本地运行,有效降低了AI规模化部署的门槛。

从供应链视角看,未来服务器DRAM和HBM的需求将持续增长。预计到2026年,服务器DRAM需求将增长39%,HBM需求年增58%。这意味着,TurboQuant的优化效果或将被行业增长浪潮所淹没。

瑞穗科技专家Jordan Klein认为,当前内存股的回调更像是一个“上车机会”,而非股价转折点。他指出,尽管内存行业一向以剧烈的周期性波动而闻名,但最近的抛售符合一种熟悉的模式,每隔几个月就会发生一次。这并非见顶的信号,逢低买入反而能赚钱。

以亚马逊和谷歌为首的四家超大规模企业计划今年斥资约6500亿美元建设数据中心,抢购英伟达的人工智能加速器及相关存储芯片。SK集团会长崔泰源近期也表示,存储芯片供应紧张的局面将持续到2030年。在这一背景下,存储芯片股的长期前景依然被多数分析师看好。

-

中国长江与埃及尼罗河,恰似两条奔腾不息的文明长河,滋养出华夏

-

一颗藏于博物馆的“明月珠”,近日引发公众对“夜明珠”的无限遐

-

25日,中国山西省考古研究院对外公布了6座西晋墓葬的发掘资料

-

(讯报班达亚齐讯)印尼总统于3月21日在亚齐大米昂(Aceh

-

(槟城 23日讯)槟城即将在本月31日迎来史上首条中国青岛直

-

近日中国社会科学院考古研究所陕西第一工作队在西安市隋唐长安城